Ces dernières années, les technologies de surveillance à Marseille se multiplient. Le changement de municipalité n’a pas enrayé ce processus de surenchère sécuritaire, au contraire. Cet article se donne pour but d’établir un état des lieux de la surveillance à Marseille, et d’expliquer en quoi elle est problématique.

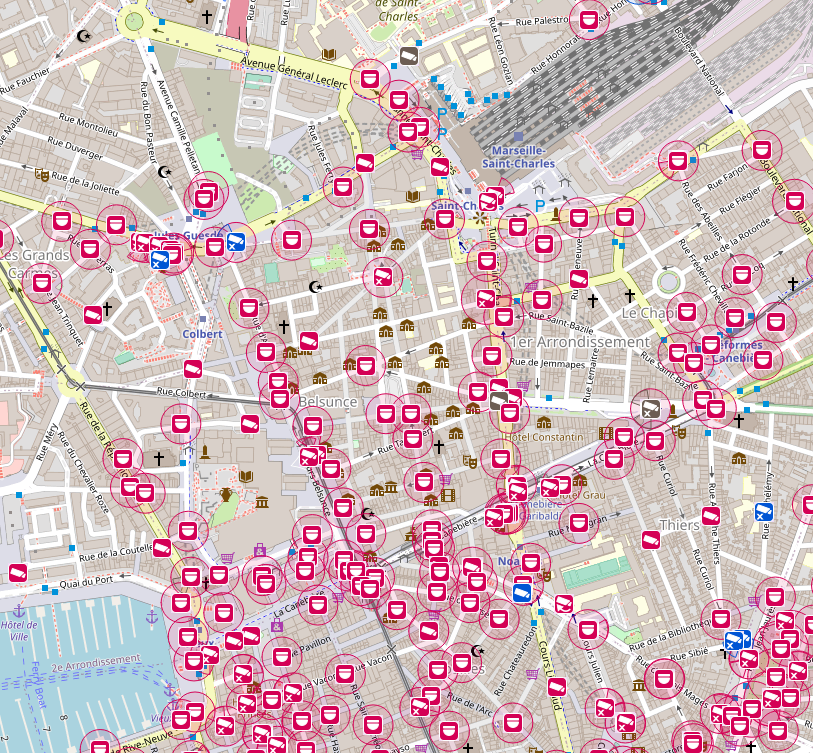

Au total, ce sont 1 558 caméras à Marseille en 2022

Depuis une quinzaine d’années, la ville de Marseille investit massivement dans les technologies de surveillance. On comptait un peu plus de 200 caméras en 2013, ce chiffre a été multiplié par sept en moins de dix ans. Ainsi, Marseille est parmi les villes les plus vidéosurveillées de France.

Elles sont partout !

Ces 1 558 caméras sont inégalement réparties, avec une forte implantation dans le centre ville. Il ne sembler exister aucun trajet permettant d’aller de la gare Saint-Charles au Vieux Port sans être vu par une caméra.

Carte en ligne des caméras : https://sunders.uber.space/?lat=43.2961743&lon=5.3699525&zoom=14

Où vont toutes ces images ? Qui est derrière les caméras ?

Le flux des caméras est envoyé au Centre de Supervision Urbaine (CSU), situé près de la Joliette, géré par la police municipale qui affecte 42 de ses agents & agentes à la visualisation des images. Dans les faits, début 2022, 4 à 5 personnes par vacation visualisent les images (matin, après-midi, soir et nuit).

En cas de suspicion ou de constatation d’infraction, de délit ou de crime sur la voie publique, ces dernières peuvent demander l’intervention d’équipes sur le terrain.

De la vidéosurveillance automatisée

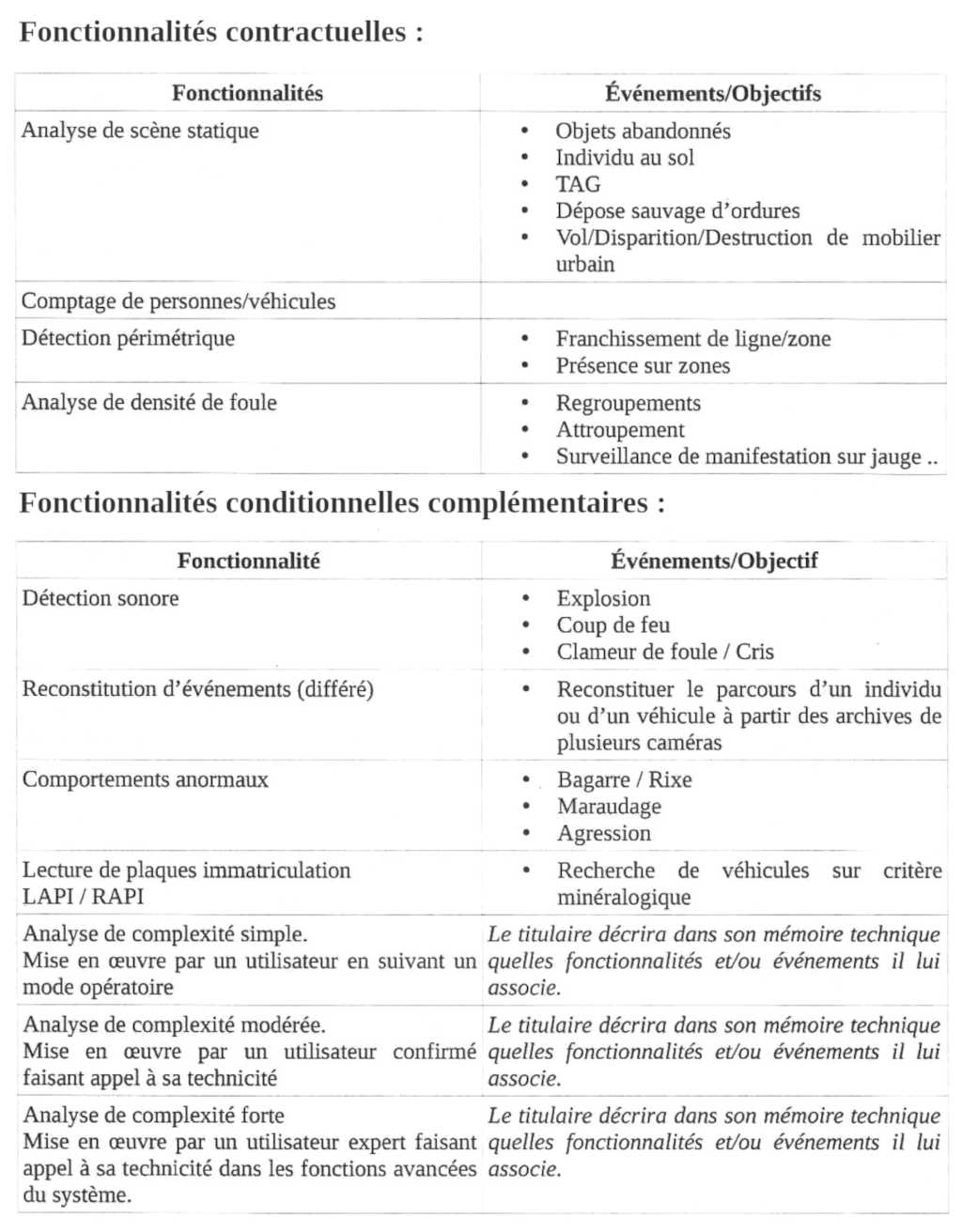

En 2018, l’entreprise privée SNEF remporte un appel d’offres de la mairie pour un projet de dispositif de vidéosurveillance automatisée ou algorithmique (VSA) (« vidéoprotection intelligente » en novlangue officielle) lancé par la mairie. Ce dispositif est en cours d’expérimentation sur 50 caméras de la ville. Le projet prévoit qu’en parallèle du personnel affecté à la visualisation des images au CSU, les caméras soient reliées à un logiciel de supervision permettant de lancer des alertes automatisées. Ces alertes viseraient à identifier des comportements suspects : regroupements de personnes, objets abandonnés, maraudage, « dépassement de ligne », etc.

Au delà de la surveillance vidéo, il est également prévu pour les caméras équipées de micros de lancer des alertes à partir du niveau sonore (clameurs de foule ou cris, bruits importants, etc). Parallèlement aux alertes, les logiciels permettraient d’effectuer des statistiques, et seraient utilisés dans le cadre d’affaires judiciaires, en permettant de faire des recherches à l’aide de filtres (description d’individu, véhicule …).

Source : https://data.technopolice.fr/fr/entity/fs2gpylqvgs?page=13

Source : https://data.technopolice.fr/fr/entity/fs2gpylqvgs?page=13

L’observatoire du Big Data et de la tranquillité publique

En 2017, en collaboration avec l’entreprise Engie Inéo, la ville de Marseille lance le projet « Big Data de la tranquillité publique ». Celui-ci vise à créer un réseau de police prédictive, rassemblant, entre autres, les données issues des caméras, des réseaux sociaux, des bases de données de la police, des partenaires externes et de dénonciations de citoyens. Un projet indépendant de la vidéosurveillance automatisée, mais qui à terme pourrait requérir les données issues de cette dernière.

Dans les finalités évoquées par la mairie lors de la signature, on trouve :

- « Mise en place d’algorithme prédictif avec prédiction spatio-temporelle des risques d’occurrence d’incidents ;

- Analyse statistique prédictive des risques de survenance de faits ;

- Mise en évidence des facteurs propices à augmenter le taux de délinquance (météo, heures de la journée, etc.) ;

- Détecter la préparation d’événements « sauvages » ou d’actes de délinquance (ex. apéro géants, marchés à la sauvette, rackets aux abords des écoles) ;

- Anticiper les risques et les menaces susceptibles de porter atteinte à l’ordre public et à la sécurité des citoyens ( ex. évaluation du risque de rassemblements dangereux par analyse des tweets, en s’appuyant sur l’identification des acteurs (qui parle ? qui agit ? qui interagit avec qui ?), remontée des fils de conversation (qui organise ? qui est le primo-déposant ?) ».

Une des finalités du projet serait même d’évaluer l’humeur des habitants (par analyse des réseaux sociaux, des appels à Allô Mairie, plaintes, etc.).

Surenchère et mensonges de la municipalité actuelle

Le changement de mairie n’a pas enrayé cet élan, et aucun des projets initiés par la majorité précédente n’a été abandonné : la nouvelle municipalité a seulement rebaptisé le projet Big Data de la tranquillité publique en « M’Pulse » et il est désormais encore plus difficile d’obtenir des informations concrètes à ce sujet.

L’expérimentation de vidéo-surveillance algorithmique (VSA) sur une cinquantaine de caméras est toujours d’actualité , alors que l’adjoint à la sécurité Yannick Ohanessian déclarait à la presse leur « suspension » suite au recours devant le Tribunal Administratif déposé par la Quadrature du Net contre ce dispositif de la ville en décembre 2020 (recours toujours en cours). Cet article récent reviens sur les dernières actualités autour de ce recours et cette fausse suspension.

Et demain ?

Avec l’arrivée des drones policiers dans l’espace public, autorisés depuis février 2022, le futur de la surveillance à Marseille est radieux. Forts de cette nouvelle technologie, caméras et micros embarquées pourront tout scruter. Quel projet de société cette accumulation de technologies de surveillance préfigure-t-elle ?

En quoi cette surveillance est-elle problématique ?

Des millions d’euros chaque année pour une ville endettée

L’entretien du réseau de caméras coûte à la collectivité plus de 7 millions d’euros par an (1 558×4 600€/an). Cela équivaut à plus que la part allouée aux travaux de réparation dans les établissements scolaires du budget 2021 avant réhabilitation lourdes et reconstructions.

L’installation d’une seule caméra coûte théoriquement entre 20000 € et 25000€. Les 500 dernières installées en 2018 ont coûté 46 millions d’euros, plus du triple du budget prévu : de quoi rénover entièrement plusieurs écoles !

Des investissements importants, mais inutiles

Les autorités justifient l’implantation de nouvelles caméras et l’utilisation de nouvelles technologies dites « intelligentes » (détection de comportements suspects, dispositifs d’alertes, etc.) à des fins de sécurité.

Cela permettrait de prévenir la délinquance et servirait à des fins d’investigation judiciaire. Or selon un rapport de la Cour des Comptes rendu en octobre 2020, « aucune corrélation globale n’a été relevée entre l’existence de dispositifs de vidéoprotection et le niveau de la délinquance commise sur la voie publique, ou encore les taux d’élucidation ».

Cette conclusion a été confirmée dans une étude récente de la gendarmerie grenobloise, menée dans quatre territoires municipaux de la région : sur la question de l’élucidation d’enquêtes, parmi celles élucidées, seules 5,87% ont bénéficié d’une contribution vidéo. Sur l’ensemble des enquêtes menées, élucidées ou non, ce pourcentage atteint même 1,1%.

Concernant la prévention de la délinquance, l’étude ne dénote aucune diminution significative du nombre d’infractions après l’installation de nouvelles caméras. En effet, de nombreuses études menées en Angleterre, en Australie ou en Suisse montrent également que les problèmes de délinquance visés par l’installation de caméras ne sont que déplacés vers d’autres zones urbaines. Enfin, d’autres études constatent même la durée limitée dans le temps de l’effet dissuasif ou préventif mis en avant.

Ces technologies renforcent les discriminations existantes

Pire, ces dispositifs renforcent les discriminations, de leurs lieux d’implantation jusqu’aux algorithmes de reconnaissance faciale qu’ils pourraient, à terme, utiliser. Les études constatent des effets discriminatoires et des biais sociaux accentués envers certaines catégories sociales (populations pauvres, réfugiés, habitants et habitantes de cités… comme le montre ce rapport de l’Institut de l’Aménagement et d’Urbanisme).

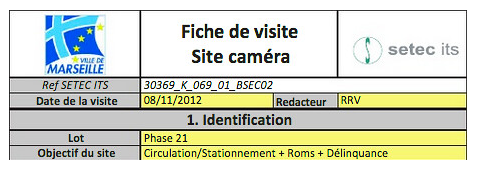

À Marseille, lors de l’installation des premières caméras, dans le cahier des charges, chaque site d’implantation d’une caméra indiquait son objectif : actes de délinquance, stationnement gênant, lieux touristiques, etc. Parmi ceux-ci, plusieurs sites mentionnaient l’objectif « Roms » ou « gens du voyage », affichant sans complexe le caractère raciste de ces dispositifs !

En octobre 2017, la CNIL [1] publiait un rapport sur les données dans la smart-city :

« Si les systèmes basés sur de l’algorithmie prédictive promettent de produire des résultats, ils sont aussi de formidables reproducteurs de biais. Plusieurs expériences ont par exemple démontré que les outils d’aide à la localisation des forces de l’ordre avaient tendance à renforcer certaines discriminations et qu’en termes d’efficacité, ils relevaient davantage de la prophétie auto-réalisatrice. »

Le contrôle automatisé de nos comportements se fait à notre détriment : l’exemple du stationnement des PMR

Au vu de ces critiques, les soutiens de la vidéoprotection nous assurent que les nouvelles technologies, et notamment l’analyse automatisée des images, sont une solution pour palier aux défaillances de la vidéosurveillance actuelle.

Outre le coût de ces nouvelles technologies, l’automatisation du traitement policier est dangereuse : en témoigne la situation ubuesque que les personnes à mobilité réduite (PMR) subissent pour stationner.

Leur carte européenne de stationnement leur permet de se garer gratuitement pendant 24h sur tous les stationnements payants de la ville. Ces cartes ne sont pas attribuées à un véhicule ou à une plaque d’immatriculation mais sont nominatives, ce qui permet aux personnes aidantes de pouvoir utiliser leur voiture personnelle.

Cependant depuis l’instauration de la vidéo-verbalisation par voiture sentinelle (les « scancars ») ces personnes écopent de contraventions abusives. Puisque le fichier des plaques d’immatriculation ne renseigne pas si le véhicule est utilisé par une PMR, c’est aux personnes de se déplacer jusqu’à l’horodateur pour indiquer leur situation !

Beaucoup de trottoirs marseillais étant impraticables, le manque d’accès aux horodateurs complexifie une démarche déjà contraignante. Elles écopent par conséquent de contraventions, qu’elles ont l’obligation de régler avant de pouvoir les contester. Cette situation a été dénoncée par le défenseur des droits.

Cette exemple illustre bien comment la mise en place de systèmes automatisés ne prend pas en compte la diversité et la complexité de nos vies. Les instaurer à plus grande échelle, sous couvert de rationalisation et d’économies budgétaires, posera certainement de nouvelles problématiques : Comment et par qui est défini un « comportement suspect » au regard d’une caméra ?

Le risque est que ces technologies entraînent une standardisation de nos comportements dans l’espace public et restreignent nos interactions sociales et nos libertés. L’informatique doit se placer au service de l’humanité, et non le contraire.

« Je n’ai rien à me reprocher »

« Lorsque vous dites « le droit à la vie privée ne me préoccupe pas, parce que je n’ai rien à cacher », cela ne fait aucune différence avec le fait de dire « Je me moque du droit à la liberté d’expression parce que je n’ai rien à dire », ou « de la liberté de la presse parce que je n’ai rien à écrire ». » Edward Snowden

La crise sanitaire nous a démontré à quel point les lois peuvent changer brutalement et qu’un geste anodin pouvait devenir un délit. Quand la veille rentrer chez soi à 19h15 ne posait pas de problème, le lendemain après l’instauration du couvre-feu à 18h, ce même geste devenait condamnable.

Ainsi, du jour au lendemain, nous avons pour la plupart été dans une situation d’illégalité, non par opposition à la justice ou à la police, mais parce que nous avions pris du retard dans un embouteillage, ou que notre travail ne nous permettait pas de rentrer plus tôt.

Là où un contrôle policier aurait pu entendre des explications, une caméra « intelligente» verbalisera sans discernement.

Ces caméras installées sous prétexte de lutter contre la délinquance finissent par surveiller chaque citoyen et citoyenne. Cela pose des enjeux quant à notre liberté de mouvement et d’action : on ne se comporte pas de la même manière lorsque l’on se sait surveillé.

« Google sait déjà tout de moi »

D’autres diront que l’on donne déjà toutes nos données personnelles aux GAFAM (Google, Apple, Facebook-Meta, Amazon, Microsoft) à travers nos navigations sur internet. Cependant, il existe une différence importante entre les GAFAM et la vidéosurveillance de l’espace public, qui est le choix de s’y soumettre ou non. À l’heure actuelle, il est encore possible, bien que difficile, de ne pas être sur les réseaux sociaux, de ne pas effectuer de recherches sur Google ou de ne pas payer par carte bancaire.

Nous avons encore la possibilité de nous soustraire à l’enregistrement de notre comportement et de nos émotions par des firmes privées. À l’inverse, la vidéosurveillance et le traitement automatisé de nos données par les autorités ne sont jamais choisis et sont toujours subis : il est impossible de se retirer de ces dispositifs.

Vers quelle société souhaitons-nous aller ?

La crise Covid de ces dernières années a permis de faire accepter de nombreuses mesures de surveillance généralisée sous couvert d’urgence sanitaire. Dans le secteur privé, il n’est désormais pas rare de voir que des entreprises surveillent leur personnel en télétravail à l’aide de leur propre webcam. La surveillance se généralise, devient acceptable et normale, quand hier elle n’était qu’un scénario de science-fiction.

L’installation de ces technologies dans l’espace public n’est pas anodine : elle préfigure une société de contrôle permanent, où chaque personne se méfie des autres, où tout individu est suspect.

Le système de crédit social Chinois n’est peut-être plus si loin de nous ; souhaitons-nous faire de l’espace public un lieu aseptisé où tout le monde est régi par un jeu d’instructions ternaire : transport, travail, consommation ?l N’existe-t-il pas d’autres solutions que la répression permanente pour que chaque personne se sente en sécurité ? S’attaque-t-on réellement aux causes profondes des incivilités et de la délinquance en multipliant les caméras et les technologies de contrôle ? Nous voulons retrouver notre intimité et nos libertés fondamentales, et revendiquons le droit de déambuler anonymement dans nos villes sans que cela ne soit enregistré quelque part.

Agir

Les décisionnaires tentent régulièrement de gagner du terrain en proposant des expérimentations locales, parfois à la dérobée et dans l’illégalité la plus totale, adoptant la stratégie du fait accompli. C’est pourquoi il est nécessaire d’agir tôt, d’interpeller les décisionnaires et de dénoncer ces pratiques avant qu’elles ne se pérennisent.

Actuellement à Marseille, le rapport de l’audit sur la vidéosurveillance commandé par la Mairie n’a toujours pas été rendu public, et aucune réponse aux demandes d’accès à ce rapport [2] n’a été faite par les services de la mairie à ce sujet. Les expérimentations de vidéosurveillance automatisée prétendument suspendues sont finalement maintenues dans la plus grande opacité. Un recours au tribunal contre ces expérimentations illégales a été déposé par la Quadrature du Net .

Des luttes victorieuses en France et dans le monde

- En 2019, la Quadrature du Net, conjointement à la Ligue des Droits de l’Homme, la CGT et le FCPE Alpes-maritimes, a déposé un recours contre l’utilisation d’un portique à reconnaissance faciale devant deux lycées de la région PACA. En février 2020, le tribunal a donné raison aux associations et a interdit cette expérimentation.

- Début 2019, la ville de Saint-Étienne a annoncé son projet d’installer, au titre d’une expérimentation sécuritaire, plusieurs dizaines de capteurs sonores dans un quartier de la ville afin d’en capter les « bruits suspects ». Les premières phrases du projet prévoyaient également l’utilisation de drones qui auraient décollé automatiquement pour renseigner la police sur la nature des bruits. Après un avertissement de la CNIL en octobre 2019, et une forte mobilisation locale de collectif d’habitantes et habitants, la ville a fait marche arrière sur ce projet.

- Ailleurs dans le monde, les mobilisations d’habitantes & habitants a porté ses fruits : aux États-Unis de nombreuses villes ont interdit l’utilisation de la reconnaissance faciale. Au niveau européen, la campagne et pétition Reclaim Your Face tente de faire de même et d’aller encore plus loin dan l’arrêt des expérimentations biométriques au sens large (y compris donc de vidéo-surveillance automatisée) en récoltant suffisamment de signatures pour attirer l’attention de la Commission Européenne.

- A Belgrade, la mobilisation forte des habitantes et habitants contre l’installation de mille caméras dotées de reconnaissance faciale a porté ses fruits : la reconnaissance faciale a été enlevée : voir le site de la mobilisation : hiljade.kamera.rs .

- En septembre 2022 nous organisions à Marseille le premier festival Technopolice, quatre jours de projections de films, débat et rencontre entre habitantes et habitants, collectifs militants, de France, Belgique et de Belgrade : voir la page du festival.

On s’organise !

Il n’est jamais trop tard pour agir !

Interpellons les élus, dénonçons leurs agissements, faisons reculer la technopolice !

-

- Des réunions physiques mensuelles sur Marseille, tous les deuxièmes jeudis du mois, au Manifesten, 59 rue Adolphe Thiers,

- Le forum Technopolice, pour que chaque personne puisse se renseigner, se coordonner, se mobiliser ou débattre des stratégies à adopter. https://forum.technopolice.fr/

- Vous travaillez dans un secteur proche de cette surveillance ? Une plateforme pour dénoncer et fuiter des documents confidentiels, de manière totalement anonyme et sécurisée, afin de nous aider à documenter et dénoncer ces projets : https://technopolice.fr/leak/

- Vous êtes journaliste, travaillez dans la recherche, militez, ou vous vous sentez concerné et souhaitez obtenir plus d’information à ce sujet ? Une base de données en accès libre répertoriant de nombreux documents liés à la surveillance : https://data.technopolice.fr/

- Soutenez la Quadrature du Net : https://www.laquadrature.net/

[1] CNIL : Commission nationale de l’informatique et des libertés, dont la mission est de veiller à ce que l’informatique soit au service du peuple et qu’elle ne porte atteinte ni à l’identité humaine, ni aux droits, ni à la vie privée, ni aux libertés publiques & individuelles.

[2] Demandes C.A.D.A. : Commission d’Accès aux Documents Administratifs.

photo d’illustration : @douceurxtreme